Google e премахнала пасаж от правилата си за използване на изкуствен интелект, в който обещава да избягва използването на технологията за потенциално вредни цели, като например оръжия.

Принципите за изкуствен интелект на компанията преди са включвали откъс, озаглавен „Приложения на изкуствения интелект, които няма да използваме“, като „технологии, които причиняват или могат да причинят цялостна вреда“, в това число и оръжия, показват екранни снимки, разгледани от Bloomberg. Този текст вече не фигурира на страницата.

На запитване за коментар говорител на Google изпраща публикация, публикувана във вторник.

„Вярваме, че демокрациите трябва да са водещи в развитието на изкуствения интелект, като се ръководят от основни ценности като свобода, равенство и зачитане на човешките права“, пишат в публикацията Джеймс Манийка, старши вицепрезидент на Google, и Демис Хасабис, който ръководи лабораторията за изкуствен интелект Google DeepMind. „Вярваме, че компаниите, правителствата и организациите, които споделят тези ценности, трябва да работят заедно, за да създават изкуствен интелект, който защитава хората, насърчава глобалния растеж и подкрепя националната сигурност.“

Премахването на клаузата за „вреда“ може да има последици за вида работа, която Google ще извършва, каза Маргарет Мичъл, която е съуправител на екипа за етичен изкуствен интелект в Google, а сега е ръководител на отдела по етика в AI стартъпа Hugging Face.

„Премахването на тази клауза заличава работата, която толкова много хора в областта на етичния изкуствен интелект и активисти са положили в Google, а още по-голям проблем е, че това означава, че компанията вероятно сега ще работи за внедряване на технологии, които могат да убиват хора“, казва тя.

Промяната е част от цялостна тенденция за изменение на политиките на големите технологични компании. През януари Meta Platforms Inc. прекрати голяма част от усилията си за многообразие и приобщаване, като заяви на служителите, че вече няма да се изисква от тях да интервюират кандидати от по-слабо представен произход за свободни позиции. През същия месец Amazon.com Inc. преустанови някои програми за многообразие и приобщаване, като високопоставен ръководител на отдел „Човешки ресурси“ ги нарече „остарели“. Администрацията на президента Доналд Тръмп се противопоставя на инициативите за многообразие.

Трейси Пицо Фрей, която от 2017 г. до 2022 г. е ръководила т.нар. отговорен изкуствен интелект в Google Cloud, споделя, че в работата на нейния екип всеки ден са се ръководили от принципите на изкуствения интелект. „Те ни помолиха да направим дълбок анализ на работата, която вършим във връзка с всеки един от тях“, заявява тя в съобщение. „И аз съм дълбоко убедена, че това направи продуктите ни по-добри. Отговорното използване на изкуствен интелект е източник на доверие. А доверието е необходимо за успеха.“

Служителите на Google отдавна обсъждат как да балансират между етичните проблеми и конкурентната динамика в областта на изкуствения интелект, особено след старта на ChatGPT на OpenAI, който повиши напрежението върху гиганта за търсенето. През 2023 г. някои служители на Googlе са изразили опасения пред Bloomberg, че стремежът на компанията да си възвърне позициите в областта на изкуствения интелект води до етични нарушения.

Още по темата

- 1 Саудитска Арабия може да сложи край на шистовата революция в САЩ

- 2 Българските IT таланти може да спечелят от сблъсъка между САЩ и Китай

- 3 Американските активи вече не изглеждат изключителни при Тръмп 2.0

- 4 Сезонността в туризма не се увеличава с постановления, а с адекватна реклама

- 5 А защо Китай да не използва като оръжие външния дълг на САЩ, който държи

Бизнес старт – сутрешен блок с Роселина Петкова и Христо Николов

Бизнес старт – сутрешен блок с Роселина Петкова и Христо Николов

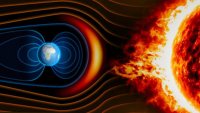

Мощна слънчева буря удря Земята

Мощна слънчева буря удря Земята  Тежка катастрофа край Пловдив, има загинал

Тежка катастрофа край Пловдив, има загинал  Варна е домакин на десетото издание на Българския географски фестивал

Варна е домакин на десетото издание на Българския географски фестивал  Разстреляха китайски мафиот с партньорката му в Рим

Разстреляха китайски мафиот с партньорката му в Рим

Доживотен затвор за бивш полицейски шеф от Балтимор, насилвал сексуално деца

Доживотен затвор за бивш полицейски шеф от Балтимор, насилвал сексуално деца  Какво означава слабият долар за световната икономика?

Какво означава слабият долар за световната икономика?  Джей-Зи и Бионсе замесени в ново дело срещу Пи Диди, но какво се случи?

Джей-Зи и Бионсе замесени в ново дело срещу Пи Диди, но какво се случи?  Символно значение на различните цветове на окото против уроки

Символно значение на различните цветове на окото против уроки

Спортът по телевизията днес, 17 април

Спортът по телевизията днес, 17 април  Мачовете по телевизията днес, 17 април

Мачовете по телевизията днес, 17 април  Във Вила все още се чудят дали да купят Рашфорд

Във Вила все още се чудят дали да купят Рашфорд  Нюкасъл вече е трети във Висшата лига след разгром над Палас

Нюкасъл вече е трети във Висшата лига след разгром над Палас

Световната кола на годината пак е Kia

Световната кола на годината пак е Kia  Находката на годината: изгубеното Ferrari на Майкъл Джордан

Находката на годината: изгубеното Ferrari на Майкъл Джордан  Забравете за минералното масло

Забравете за минералното масло  Hyundai направи батерия за EV с вграден пожарогасител

Hyundai направи батерия за EV с вграден пожарогасител

продава, Парцел, 5000 m2 Варна област, с.Самотино, 80000 EUR

продава, Парцел, 5000 m2 Варна област, с.Самотино, 80000 EUR  продава, Сграда, 450 m2 Добрич област, гр.Каварна, 0 EUR

продава, Сграда, 450 m2 Добрич област, гр.Каварна, 0 EUR  продава, Четиристаен апартамент, 185 m2 София, Център, ул. Хан Крум, 732000 EUR

продава, Четиристаен апартамент, 185 m2 София, Център, ул. Хан Крум, 732000 EUR  продава, Четиристаен апартамент, 275 m2 София, Лозенец, 948000 EUR

продава, Четиристаен апартамент, 275 m2 София, Лозенец, 948000 EUR  продава, Многостаен апартамент, 275 m2 София, Лозенец, 948000 EUR

продава, Многостаен апартамент, 275 m2 София, Лозенец, 948000 EUR