Според доклад, публикуван от Microsoft Corp. в сряда, поддържани от държавата хакери използват изкуствен интелект (ИИ), за да усъвършенстват кибератаките си.

Установено е, че подкрепяни от Русия, Северна Корея, Иран и Китай противници добавят големи езикови модели, като ChatGPT на OpenAI, към своя инструментариум, често в предварителните етапи на хакерските си операции, установиха изследователите. Някои групи са използвали технологията, за да подобрят своите фишинг имейли, да съберат информация за уязвимости и да отстранят свои собствени технически проблеми, сочат констатациите.

Това е най-големият досега сигнал, че спонсорираните от държавата групи за кибершпионаж, които от години преследват бизнеса и правителствата, подобряват тактиките си въз основа на публично достъпни технологии, като например големи езикови модели. Експерти по сигурността предупреждават, че подобна еволюция ще помогне на хакерите да събират повече разузнавателна информация, да повишат своята надеждност, когато се опитват да заблудят цели, и да пробият по-бързо мрежите на жертвите. OpenAI заяви в сряда, че е прекратила акаунти, свързани с държавно спонсорирани хакери.

"Участниците в заплахите, както и защитниците, гледат към изкуствения интелект, включително LLM, за да повишат производителността си и да се възползват от достъпни платформи, които биха могли да развият техните цели и техники за атака", се казва в доклада на Microsoft.

Според компанията няма значими атаки, при които да е използвана технологията LLM. През януари 2023 г. изследователи в областта на политиката предупредиха, че хакерите и други лоши участници онлайн ще намерят начини да злоупотребят с нововъзникващите технологии на изкуствения интелект, включително за подпомагане на писането на злонамерен код или разпространяването на операции за влияние.

Сред хакерските групи, които са използвали ИИ в своите кибероперации, е Forest Blizzard, която според Microsoft е свързана с руското правителство. Севернокорейската група Velvet Chollima, която се е представяла за неправителствени организации, за да шпионира жертви, и китайските хакери Charcoal Typhoon, които се фокусират предимно върху Тайван и Тайланд, също са използвали такава технология, казва Microsoft. Иранска група, свързана с Ислямската революционна гвардия на страната, е използвала LLM, като е създавала измамни имейли, един от които е бил използван за привличане на известни феминистки, а друг се е представял за международна агенция за развитие.

Констатациите на Microsoft идват на фона на нарастващата загриженост на експертите и обществеността относно сериозните рискове, които ИИ може да породи за света, включително дезинформация и загуба на работни места. През март 2023 г. над хиляда души, включително видни ръководители на големи технологични компании, подписаха отворено писмо, в което предупреждават за рисковете, които ИИ може да има за обществото. Повече от 33 000 души са подписали писмото.

Друга заподозряна руска хакерска група, известна като Midnight Blizzard, преди това е компрометирала имейли на ръководители на Microsoft и членове на персонала по киберсигурност, съобщи компанията през януари.

Още по темата

- 1 Саудитска Арабия може да сложи край на шистовата революция в САЩ

- 2 Българските IT таланти може да спечелят от сблъсъка между САЩ и Китай

- 3 Американските активи вече не изглеждат изключителни при Тръмп 2.0

- 4 Сезонността в туризма не се увеличава с постановления, а с адекватна реклама

- 5 А защо Китай да не използва като оръжие външния дълг на САЩ, който държи

Бизнес старт – сутрешен блок с Роселина Петкова и Христо Николов

Бизнес старт – сутрешен блок с Роселина Петкова и Христо Николов

Мощна слънчева буря удря Земята

Мощна слънчева буря удря Земята  Тежка катастрофа край Пловдив, има загинал

Тежка катастрофа край Пловдив, има загинал  Варна е домакин на десетото издание на Българския географски фестивал

Варна е домакин на десетото издание на Българския географски фестивал  Разстреляха китайски мафиот с партньорката му в Рим

Разстреляха китайски мафиот с партньорката му в Рим

Символно значение на различните цветове на окото против уроки

Символно значение на различните цветове на окото против уроки  Флорънс Пю не иска да остава сама, но е много заета

Флорънс Пю не иска да остава сама, но е много заета  Шайло Джоли показа новата си татуировка

Шайло Джоли показа новата си татуировка  Бен Афлек призна: Не ме бива във флиртуването

Бен Афлек призна: Не ме бива във флиртуването

Драма с ВАР, но Арсенал довърши Реал след нервно 2:1 на "Бернабеу"

Драма с ВАР, но Арсенал довърши Реал след нервно 2:1 на "Бернабеу"  Лаутаро Велики пак посече Байерн! Интер е на полуфинал с Барса

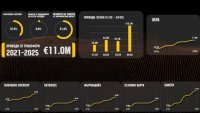

Лаутаро Велики пак посече Байерн! Интер е на полуфинал с Барса  Ботев Пловдив обяви приходите си

Ботев Пловдив обяви приходите си  Ман Юнайтед покани своя фен Рори Макилрой на "Олд Трафорд"

Ман Юнайтед покани своя фен Рори Макилрой на "Олд Трафорд"

Световната кола на годината пак е Kia

Световната кола на годината пак е Kia  Находката на годината: изгубеното Ferrari на Майкъл Джордан

Находката на годината: изгубеното Ferrari на Майкъл Джордан  Забравете за минералното масло

Забравете за минералното масло  Hyundai направи батерия за EV с вграден пожарогасител

Hyundai направи батерия за EV с вграден пожарогасител

продава, Парцел, 5000 m2 Варна област, с.Самотино, 80000 EUR

продава, Парцел, 5000 m2 Варна област, с.Самотино, 80000 EUR  продава, Сграда, 450 m2 Добрич област, гр.Каварна, 0 EUR

продава, Сграда, 450 m2 Добрич област, гр.Каварна, 0 EUR  продава, Четиристаен апартамент, 185 m2 София, Център, ул. Хан Крум, 732000 EUR

продава, Четиристаен апартамент, 185 m2 София, Център, ул. Хан Крум, 732000 EUR  продава, Четиристаен апартамент, 275 m2 София, Лозенец, 948000 EUR

продава, Четиристаен апартамент, 275 m2 София, Лозенец, 948000 EUR  продава, Многостаен апартамент, 275 m2 София, Лозенец, 948000 EUR

продава, Многостаен апартамент, 275 m2 София, Лозенец, 948000 EUR